Reconhecimento facial para fins policiais é uma tecnologia que existe há décadas, mas é atualmente impulsionada pelos aparentes avanços na computação visual e custo-benefício de gerenciamento de bases gigantescas de dados e imagens.

Entretanto, também é no reconhecimento facial onde os problemas da (des)inteligência artificial se apresentam de forma mais visível. Nos últimos anos, pesquisadoras propuseram o conceito de “disparidade interseccional” para descrever como o recurso acumula taxas de erros em pessoas negras e sobretudo em mulheres negras.

Inúmeras auditorias de diferentes origens – incluindo realizada pelo governo estadunidense – chegaram à conclusões similares sobre a disparidade interseccional que vulnerabiliza ainda mais grupos violentados pelo estado.

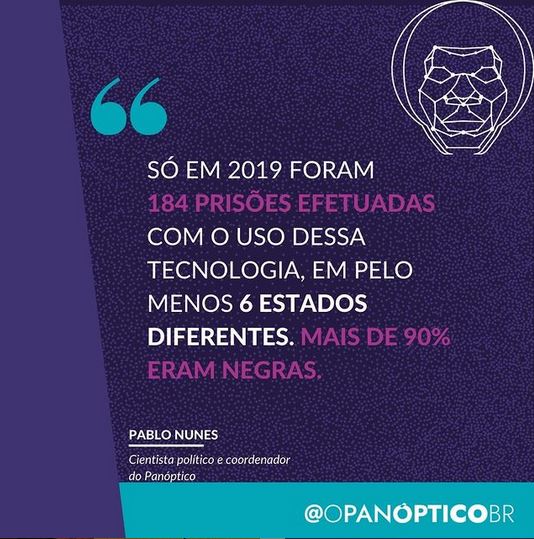

Entretanto, também cabe perguntar: queremos mais tecnologias de vigilância voltadas a promover o encarceramento em massa? Reconhecimento facial para fins policiais tende a gerar mais violência estatal contra pessoas pobres e minorias através da persecução relacionada a crimes sem vítima como furto ou tráfico. Estudos no Brasil, Canadá, Reino Unido e outros mostram os impactos nocivos do reconhecimento facial.

Apesar da normalização da tecnologia em alguns lugares, há resistências e banimentos em ação. É possível desinventá-la antes de se estabelecer.